L'intelligenza artificiale sta diventando sempre più una parte insostituibile di applicazioni mobili, software e sistemi CRM di diversi tipi. Il libro paga è una voce significativa nel budget di un'azienda, poiché varia dal 20-30 al 60% dei costi, rappresentando in media il 40%. Implementare algoritmi di intelligenza artificiale nei processi tecnologici significa abbandonare dipendenti poco qualificati e di medio livello, ridurre il costo del lavoro e aumentare progressivamente i profitti. Diamo un'occhiata agli esempi che mostrano come l'introduzione e l'adattamento dell'IA nella struttura dei processi aziendali dimostri l'efficacia e quanto costa sviluppare un'applicazione AI.

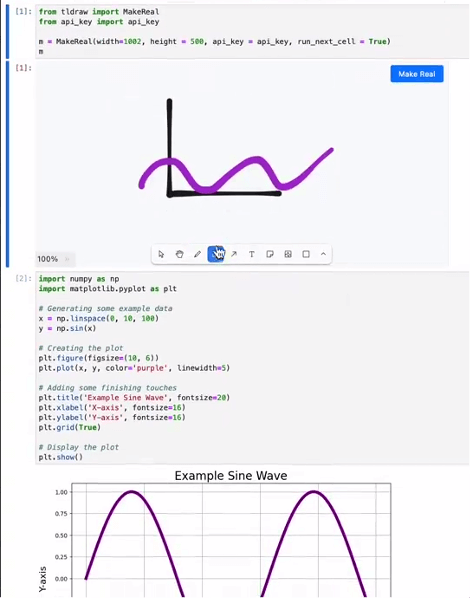

Simbiosi tra GPT-4 Vision e Jupyter Notebook

La versione 4 di GPT Vision rilasciata di recente interagisce bene con il notebook interattivo Jupyter. Aumentando l'intelligenza artificiale con codice scritto in Python, l'utente, in risposta a un disegno realizzato con il movimento della mano, riceve grafici chiari generati sotto forma di parabole o sinusoidi, immagini circolari multicentriche. L'inserimento di una descrizione con numeri e curve approssimative produce una visualizzazione dettagliata di un dato formato. La multimodalità e la stima visiva relativamente accurata vengono utilizzate in situazioni in cui è necessario determinare posizioni, analizzare e interpretare le immagini “sul foglio”, calcolare il modello secondo parametri matematici specificati.

Questa soluzione è utile per ingegneri e progettisti, costruttori e analisti. Basta abbozzare un disegno a mano e integrarlo con chiarimenti testuali e il software produrrà in pochi secondi un grafico, un diagramma o un piano già pronto con linee e dimensioni chiare. Il semplice codice scritto in Python e incorporato nei servizi AI fornisce una chiara riproduzione di un dato formato lineare. Per risolvere problemi complessi, importa moduli e pacchetti, scarica e compila distribuzioni e installa altre librerie.

Il progetto Jupyter dispone di tali opzioni per l'implementazione e lo sviluppo di algoritmi AI: ambiente web, applicazione per il calcolo di analisi e dati digitali, versione semplificata di pagine statiche, widget e dashboard con interazione multilaterale. Si possono utilizzare uno o più elementi della funzionalità a seconda di quale sia il compito degli sviluppatori, adattando l'IA alle richieste.

Applicazione Labelme e librerie Deepface

L'annotazione visiva è un nuovo passo nella programmazione e nell'implementazione dell'intelligenza artificiale. Il codice open source di Python e il modulo di programmazione semplificato forniscono annotazioni visive seguite dall'elaborazione in una struttura logica rigorosa. La visione artificiale è un segmento dell’intelligenza artificiale. Riconosce ed elabora le informazioni visive, effettua analisi di video, contenuti e altre immagini utilizzando i dati di un database generato in precedenza.Labelme è un esempio di una classica applicazione grafica creata sulla piattaforma open source LabelMe sviluppata da specialisti con sede nel Massachusetts nel 2008. La segmentazione e la classificazione, il formato dell'interfaccia utente personalizzabile garantiscono un comodo lavoro di markup manuale online o offline. Qt è lo strumento grafico della sua interfaccia.

Il riconoscimento facciale in tempo reale utilizzando la libreria Deepface, creata in Python, fornisce l'identificazione umana con una precisione del 98-99%. Allo stesso modo, i modelli di intelligenza artificiale basati su di esso identificano l'età, le emozioni e il sesso di una persona, confrontandoli istantaneamente con centinaia di immagini. La libreria è l'estratto di soluzioni modello testate come VGG-Face e OpenFace, ArcFace con Dlib, GhostFaceNet e altri, eseguendo attività di riconoscimento come rilevatore entro 5 secondi. Ciò è importante per la sicurezza in luoghi con elevata concentrazione e percorribilità di persone: aeroporti, stazioni, centri commerciali.

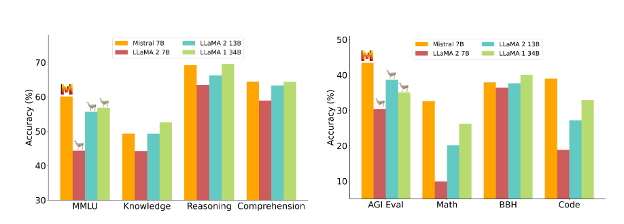

Implementazione di moduli AI e confronto basati su Mistral 7B

Il settore GPT ha raggiunto un punto in cui i modelli neurali LLM lavorano su metà delle attività aziendali. L'implementazione delle funzionalità AI e dello strumento AI in BPM estende il ciclo di vita semplificando l'identificazione e l'analisi iniziale. AI Tool esegue inoltre la riprogettazione con l'implementazione di nuove soluzioni e il monitoraggio di follow-up. I moduli AI integrati di riferimento per i casi aziendali includono:- Valutazione del database e delle operazioni sui dati;

- CRM per cataloghi e automazione del marketplace;

- integrazione con altre API e plugin;

- adempimento di compiti di marketing (come assistente di un operatore di marketing);

- valutazione della logica dell'azione e del successo del codice.

Tali soluzioni sono più spesso sviluppate a codice chiuso per garantire la sicurezza di utenti e proprietari. Testare e scrivere suggerimenti è la base, il “cuore” dell’idea. Il modello Mistral 7B nella licenza pubblica Apache 2.0 è tra i migliori oggi disponibili. Il modello giusto può essere selezionato, sviluppato e lanciato solo da un team esperto di specialisti che valuterà la portata dei compiti, la disponibilità di risorse e strutture e il linguaggio di programmazione utilizzato.

ML: un esempio di apprendimento delle lingue basato su modelli

L'apprendimento automatico ML è caratterizzato da molte direzioni: protocolli convenzionali e apprendimento per rinforzo profondo, modelli linguistici, metodi a matrice o tensore. Le applicazioni ML riguardano l'industria e le tecnologie ad alta intensità di conoscenza, le scienze ambientali, la neurobiologia e la climatologia, per migliorare le azioni dei robot e il trasporto personale autonomo. Ad esempio, un modello linguistico prevede 4-8 token successivi in modo più accurato dopo l'addestramento sui modelli globali, mostrando risultati migliori prestazioni rispetto alla formazione su protocolli locali.La decodifica multitask si basa sull'interazione di più variabili target e sulle relazioni di regressione rilevate, sulla valutazione dei dati su una scala di perdita e sul loro successivo bilanciamento per ottenere l'effetto desiderato. Si tratta di compiti di alto livello, quindi il costo per lo sviluppo di tali applicazioni AI multipiattaforma parte da 100-150 mila dollari. La durata dell'addestramento di diversi modelli su un'architettura complessa multifattore con l'introduzione del ragionamento algoritmico varia da 300 a 500mila ore, il che spiega l'elevato costo di tali progetti.

L'espansione della gamma di utilizzo del modello linguistico è chiaramente illustrata da Gemma (un prodotto API Gemini), che viene eseguito nei test 2B e 7B. La libreria Keras 3.0 incorporata nel modello è responsabile della compatibilità con i framework JAX e PyTorch, libreria di formazione aperta TensorFlow, preservando elevate prestazioni operative e flessibilità delle soluzioni proposte. L'estensione delle funzionalità esistenti per soddisfare i requisiti aziendali è supportata dall'interpolazione di variabili, personalizzazione dei parametri dell'interprete, test unitari e debug con profilazione.

Wegic crea e pubblica siti web

Il successo dell’implementazione dell’intelligenza artificiale è evidente nell’esempio della piattaforma Wegic, che sostituisce programmatore e progettista UI/UX in un’unica persona. È sufficiente scrivere un messaggio competente, fornire chiarimenti, specificare la combinazione di colori desiderata e la posizione degli elementi in modo che il sito sia pronto senza scrivere codice. Non è possibile realizzare versioni complesse di siti con centinaia di pagine e categorie, con menu distribuibili e un mercato che supporta migliaia di transazioni con gateway finanziari sicuri.

Tuttavia, le capacità tecniche e software della piattaforma sono sufficienti per generare un sito di biglietti da visita, una pagina di marchio personale con un portfolio, un semplice sito web per vendere con un numero limitato di posizioni. Tale piattaforma può essere sviluppata anche per altri scopi, ad esempio per la modellazione AI di edifici e interni di case, progettazione stradale, complessi di supporto vitale e produzione alimentare. I primi tre siti di Wegic sono gratuiti: vengono assegnati 120 crediti. Quando finiscono, il pagamento per i piani a basso costo parte da $ 10 al mese. Una volta creato un sito, la piattaforma lo pubblica online dopo poco tempo.

Un iPhone con OpenAI integrata e AI "memoria personale"

All’inizio del 2024 ci saranno più di 1,5 miliardi di possessori di iPhone nel mondo. Circa un abitante su cinque nel mondo utilizza dispositivi mobili Apple. Per migliorare il lavoro di Siri, si è saputo che ChatGPT sarà implementato nella 18a versione di iOS. I proprietari di OpenAI non hanno ancora raggiunto un accordo completo sui termini, ma il fatto che il chatbot Gemini faccia parte dell'aggiornamento indica che siamo pronti per il prossimo cambiamento tecnologico nel campo dell'intelligenza artificiale. I dettagli saranno rivelati nel giugno 2024.Le informazioni fornite confermano il fatto che le soluzioni di OpenAI e altri sviluppi nel campo delle reti neurali stanno guadagnando slancio. Analisi immediata dei dati dei clienti, segmentazione delle richieste e delle risorse finanziarie, mantenimento dei contatti personali sulla base delle transazioni precedenti: un piccolo elenco di funzionalità dell'intelligenza artificiale che vale la pena implementare in un progetto aziendale per aumentare la redditività.

Il database ricorderà che una persona specifica ha ordinato una cabina senza equipaggio con un seggiolino per bambini. La prossima volta l'applicazione con intelligenza artificiale integrata specificherà se è necessario un seggiolino per auto. All'acquirente di un laptop tra un anno o due verrà offerto di passare a un nuovo modello che è migliore e più potente della versione precedente. L'IA invierà un'offerta vantaggiosa con un paniere del set preferito se si sa che in certi periodi dell'anno le persone acquistano solo pesce e frutti di mare, rifiutando carne, uova e latte.

Le reti neurali necessitano di protocolli chiari

Di conseguenza, gli abitanti della Pennsylvania hanno sviluppato la piattaforma DrEureka, dove i modelli linguistici dell’intelligenza artificiale insegnano ai robot. Utilizzando l'esempio di un cane robot, l'intelligenza artificiale ha mostrato come generare codice e premiare o punire il robot passo dopo passo come risultato di ogni simulazione eseguita con successo, tenendo conto del bilanciamento basato sulla massa della macchina e sullo spostamento nello spazio. La particolarità è la creazione ed esecuzione di più scenari contemporaneamente, cosa considerata possibile solo per gli esseri umani.Ecco un esempio: una donna può parlare al telefono con un dispositivo wireless, friggere bistecche e contemporaneamente versare lo yogurt al bambino, passando poi ad altre faccende. Al giorno d'oggi, una rete neurale genera ed esegue fino a una dozzina di algoritmi di azioni in parallelo. Ma servono controlli e protocolli di divieto ben definiti, perché per raggiungere un’efficienza e un risparmio energetico superiori alla soglia, l’intelligenza artificiale potrebbe consentire azioni pericolose.

Presumibilmente per calcolare che un’auto drone viaggerà più velocemente su tre ruote. Si può ritenere che i parenti sconosciuti venuti a visitare durante l'assenza dei proprietari siano ladri, quindi è necessario bloccare finestre e porte e chiamare la guardia. A tal fine è necessario un controllo con l'indicazione del divieto assoluto di compiere determinate operazioni.

ZeST come base per la progettazione grafica

Le applicazioni a basso costo con un prezzo compreso tra 20 e 50 mila dollari possono essere basate su metodi di tipo ZeST, in cui un campione pilota cambia aspetto e struttura in base al materiale. Nonostante il formato 2D, un punto di riferimento fisso sulle proprietà del materiale donatore trasferisce completamente le sfumature all'oggetto originale, regolando scala e illuminazione. La profondità e le sfumature di colore sono codificate dall'adattatore IP preservando le altre differenze visive degli oggetti. Il metodo è parzialmente simile a B-LoRA e ai principi di styling di InstantStyle.

La texture modificata dall'intelligenza artificiale sarà utile per i produttori di mobili e tessuti, produttori di porcellana e altri produttori in cui è necessario regolare la combinazione di colori. Il metodo rappresenta una “bacchetta magica” indispensabile per la progettazione grafica e la progettazione edilizia di esterni ed interni. Supponiamo che il cliente voglia rifinire il soggiorno e la camera da letto in stile rococò o barocco, classicismo o lusso. Scegli gli elementi giusti e l'applicazione AI li genererà di nuovo nella tavolozza giusta, presentando istantaneamente una serie di prototipi.

DALL-E, VQGAN e CLIP per la generazione multimodale

La creatività multimodale è riconosciuta come uno strumento per la psicoterapia, un modo per migliorare il pensiero spaziale e per sviluppare progetti multi-immagine. La tokenizzazione in DALL-E è tale che viene formata metà dell'immagine basato sul disegno, l'altra metà sul testo. Le reti neurali, una volta addestrate, spesso generano un'immagine virale tenendo conto di parametri spaziali, eventi ed emozioni, creano una criptovaluta. Netflix, il generatore di siti Web Jekyll e il sito di ricerca Yelp, i social network Facebook e Twitter utilizzano le sue risorse per aumentare il numero del pubblico target.

Queste funzioni sono adatte anche alla creazione di giochi, al design, al supporto visivo del progetto, per cui possono essere considerate una componente della società con crescente importanza. L'analogo del DALL-E chiuso è CLIP, la cui funzionalità è stata ridotta della metà rispetto all'originale. Un'estensione delle due reti neurali è l'avversario VQGAN, che funziona in un formato di generazione avversaria in cui il generatore e il discriminatore competono. VQGAN e CLIP interagiscono perfettamente, in quanto il primo genera l'immagine e il secondo come ranking analizza la pertinenza al compito.

Il costo maggiore dell'addestramento delle reti neurali risiede nella raccolta dei dati e nel successivo sviluppo dell'intelligenza artificiale. Per produrre immagini ad alta risoluzione, al codificatore e al decodificatore quantizzati viene insegnato a ricostruire modelli basati sulla semantica. Richiede un libro di codici e una quantizzazione vettoriale con distribuzione. Esiste un problema nel volume limitato degli strati convoluzionali e nell'architettura del trasformatore considerando la scalabilità quadratica. Ecco perché abbandonare i pixel per codificare le parole con sequenze di indici e utilizzare il servizio Colab è una via d'uscita dal problema della scarsità di risorse.

L'assistente AI Verba e Trillium stanno addestrando i modelli AI

Le applicazioni Verba sono assistenti IA universali. Funziona con dati locali e risorse cloud, risponde alle query, recupera le informazioni necessarie e genera report. L'applicazione funziona utilizzando il metodo RAG, sfrutta il database vettoriale Weaviate e il relativo repository. Il software interagisce con LLM come il modello linguistico HuggingFace o Ollama, il framework OpenAI, la piattaforma Cohere.Trillium, il TPU di sesta generazione che Google lancerà presto su larga scala, combinato con interruttori ottici, è pronto per addestrare modelli IA di complessità medio-bassa. Trillium è 5 volte più veloce della versione precedente, contiene 256 chip funzionanti in una singola unità. Il TPU è in grado di utilizzare 4096 chip in un cluster con funzionamento multislice. Ci sono centinaia di “pod” nel cluster stesso.

Se consideriamo che lo stipendio medio annuo di un dipendente negli Stati Uniti e nei paesi sviluppati dell’UE è di 50-60mila dollari e che lo sviluppo di un’applicazione di intelligenza artificiale sostituirà da una a tre o cinque persone, i vantaggi economici sono evidenti. La formazione del modello neuronale, la creazione e l'implementazione dell'applicazione AI nel CRM di medio livello di complessità si ripagheranno in 3-12 mesi. Lo sviluppo della struttura del feed di dati, gli algoritmi per l'inserimento di moduli aggiornati e l'analisi delle basi relazionali richiedono l'uso di programmazione e socket paralleli, operazioni di test durante il processo di lancio, quindi il prezzo dell'ordine potrebbe essere più alto.

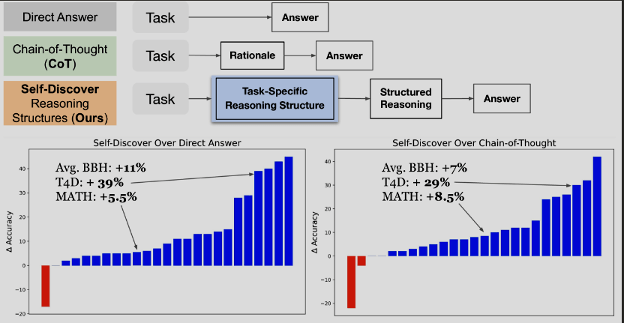

Self-Discover risolve i problemi con il metodo dell'auto-scoperta

Che i modelli linguistici migliorino costantemente la propria funzionalità è chiaramente dimostrato dalla novità di Self-Discover con il kernel, dove il LLM seleziona moduli di ragionamento atomico con operazioni critiche e passo-passo durante la decodifica in un processo di auto-scoperta. È meglio di un modo di pensare a catena, poiché ogni passaggio è seguito da un'inferenza specifica del modo di pensare umano con un programma di ragionamento, meta- e segnali diretti.

Self-Discover si basa sul principio di autocoerenza e di ragionamento paradossale, quando un modello di intelligenza artificiale crea un algoritmo logicamente corretto sulla base dello stack coinvolto. Il ragionamento universale attraversa le fasi di selezione di un modo per risolvere il problema, adattandolo a condizioni specifiche e esecuzione diretta. L'ambiente è adatto alla risoluzione di test complessi, le strutture di ragionamento vengono implementate e trasferite a diversi LLM.

Visualizzazione dello Splatting gaussiano e miglioramento dello SLAM

Le immagini 3DGS tridimensionali ottenute utilizzando il principio gaussiano dello splatting hanno accelerato i processi di addestramento del modello e aumentato la velocità di rendering delle visualizzazioni realistiche. Il metodo Deblur-GS ripristina gli elementi sfocati e rimuove gli artefatti modificando la matrice di covarianza che determina il colore e la densità degli oggetti. Questa tecnica è migliore della NeRF, un tempo popolare, che si basa sul principio della formazione del “campo luminoso”.La formazione di modelli AI per produrre immagini e disegni a 1080p è indispensabile per le aziende che producono foto e video realistici e di alta qualità o per lo sviluppo di applicazioni AR. Questo metodo è importante anche per SLAM in situazioni in cui vengono utilizzate la mappatura e la navigazione robotica, basate sulle osservazioni dei sensori e sull'odometria. In pratica, viene implementato nei processi di addestramento dell’IA per il movimento sicuro di veicoli senza pilota, dispositivi subacquei e volanti come i droni, visualizzazione di organi del corpo durante esami medici.

Recentemente è stato scritto in Python un componente aggiuntivo per selezionare momenti accattivanti da podcast, video, conferenze, in modo che il software interagisca con CrewAI e la versione 4 di GPT-o (quest'ultimo servizio AI necessita di una chiave). L'applicazione aggiunge i sottotitoli al nuovo video dopo aver tagliato i fotogrammi secondo l'algoritmo stabilito. Ridurre ed estrarre in modo intelligente i punti chiave delle informazioni diminuisce il tempo di analisi del volume: questo è il principio “Non far riflettere troppo il cliente”.

Il percorso dell'intelligenza artificiale è come una nave dal porto all'oceano

L’implementazione dell’intelligenza artificiale nelle applicazioni e nel CRM è così vasta che è impossibile descrivere tutti i progetti che utilizzano reti neurali addestrate. Gli esempi di interazione GPT-4 e Jupyter, la valutazione delle persone con Labelme e Deepface, l'incorporamento di moduli e la scrittura di codici chiusi mostrano chiaramente la realizzazione della risoluzione dei problemi aziendali.L'apprendimento del modello linguistico offre un ampio campo agli imprenditori di siti Web e progettazione grafica che eseguono la generazione multimodale. Le applicazioni AI sviluppate si basano sul principio gaussiano e sul metodo di auto-riconoscimento. Gli assistenti AI aiutano con l'addestramento dei modelli AI. La cosa più importante è una dichiarazione precisa di protocolli e algoritmi: la complessità determina il prezzo dello sviluppo di applicazioni AI, che non supera la soglia di prezzo di 150.000 dollari.